**번역본뉴스입니다. 오역이 있을수 있습니다.

AI를 도입하는 기업들에게 데이터 주권과 컴퓨팅 성능이 전략적 차별화 요소가 됨에 따라, 프라이빗 온프레미스 AI 인프라에 대한 수요가 계속해서 증가하고 있습니다. 이러한 변화에 대응하여 컴퓨팅, 네트워킹 및 스토리지 솔루션의 선도적인 혁신 기업인 QNAP Systems, Inc.는 오늘 대규모 언어 모델(LLM), 검색 증강 생성(RAG) 검색 엔진 및 생성형 AI 애플리케이션의 프라이빗 배포를 지원하기 위해 설계된 차세대 엣지 AI 스토리지 서버인 QAI-h1290FX를 출시했습니다.

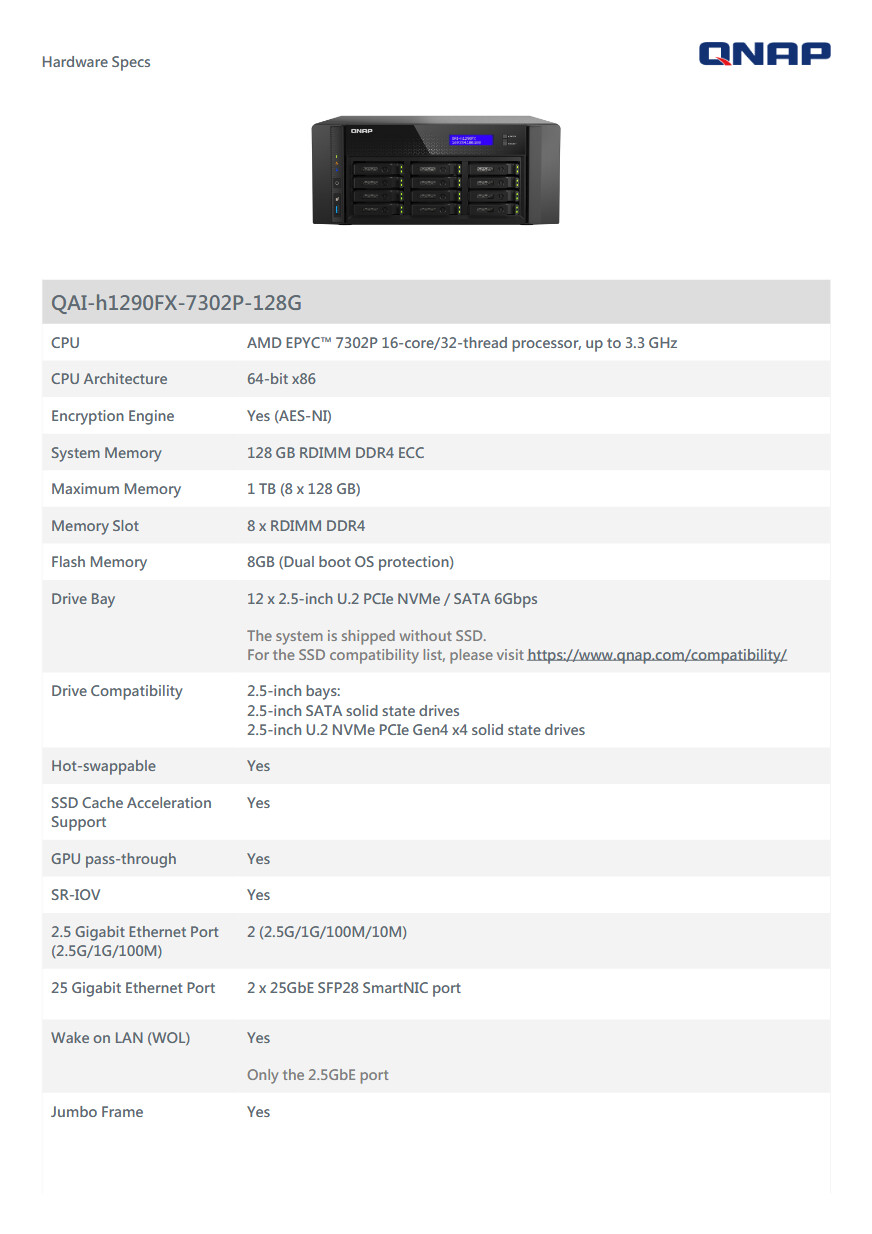

서버 등급의 AMD EPYC 프로세서, NVIDIA RTX GPU 가속 지원, 그리고 12개의 U.2 NVMe/SATA SSD 슬롯을 갖춘 QAI-h1290FX는 클라우드에 의존하지 않고 저지연 추론, 완전한 데이터 프라이버시 및 운영 제어권을 요구하는 조직을 위해 고성능 온프레미스 AI 인프라를 제공합니다.

QNAP의 ZFS 기반 QuTS hero 운영 체제로 구동되는 QAI-h1290FX는 기업급 데이터 무결성, 거의 무제한에 가까운 스냅샷 및 인라인 중복 제거 기능을 제공합니다. Container Station을 통한 컨테이너 내 네이티브 GPU 액세스와 Virtualization Station을 통한 가상 머신용 GPU 패스스루를 지원합니다. 이를 통해 IT 팀, 개발자 및 연구 그룹은 성능과 리소스 할당에 대한 완전한 제어권을 가지고 추론 모델, 생성형 AI 애플리케이션 및 RAG 파이프라인을 효율적으로 실행할 수 있습니다.

QAI-h1290FX에는 AnythingLLM, OpenWebUI, Ollama와 같이 엄선된 AI 도구들이 사전 탑재되어 있어 프라이빗 LLM 워크플로우를 신속하게 배포할 수 있습니다. 또한 기능을 확장하기 위해 Stable Diffusion, ComfyUI, n8n, vLLM과 같은 추가 AI 애플리케이션도 통합되고 있습니다. 이를 통해 사용자는 안전하고 확장 가능하며 완전히 제어된 환경에서 온프레미스 AI 플랫폼을 빠르게 구축하고 워크플로우를 자동화할 수 있습니다.

QNAP의 제품 매니저인 올리버 램(Oliver Lam)은 "QAI-h1290FX는 온프레미스 AI 인프라에 대한 증가하는 수요를 충족합니다"라며, "우리는 GPU 워크스테이션을 구축하고, 도구를 설치하며, 복잡한 환경을 구성하는 과정에서의 번거로움을 제거하고자 했습니다. QAI-h1290FX를 통해 사용자는 데이터에 대한 완전한 제어권을 유지하고 클라우드에 전혀 의존하지 않으면서도 즉시 AI 모델을 배포하고 실행할 수 있습니다"라고 밝혔습니다.

QAI-h1290FX의 주요 특징

-

올플래시 스토리지 아키텍처: 12개의 U.2 NVMe/SATA SSD 슬롯을 통해 고빈도 AI 모델 실행 및 데이터 스트리밍을 위한 초고속 I/O를 지원합니다.

-

16코어 AMD EPYC 7302P 프로세서: AI 추론, 가상화 및 과중한 병렬 워크로드에 이상적인 32스레드의 서버급 컴퓨팅 성능을 제공합니다.

-

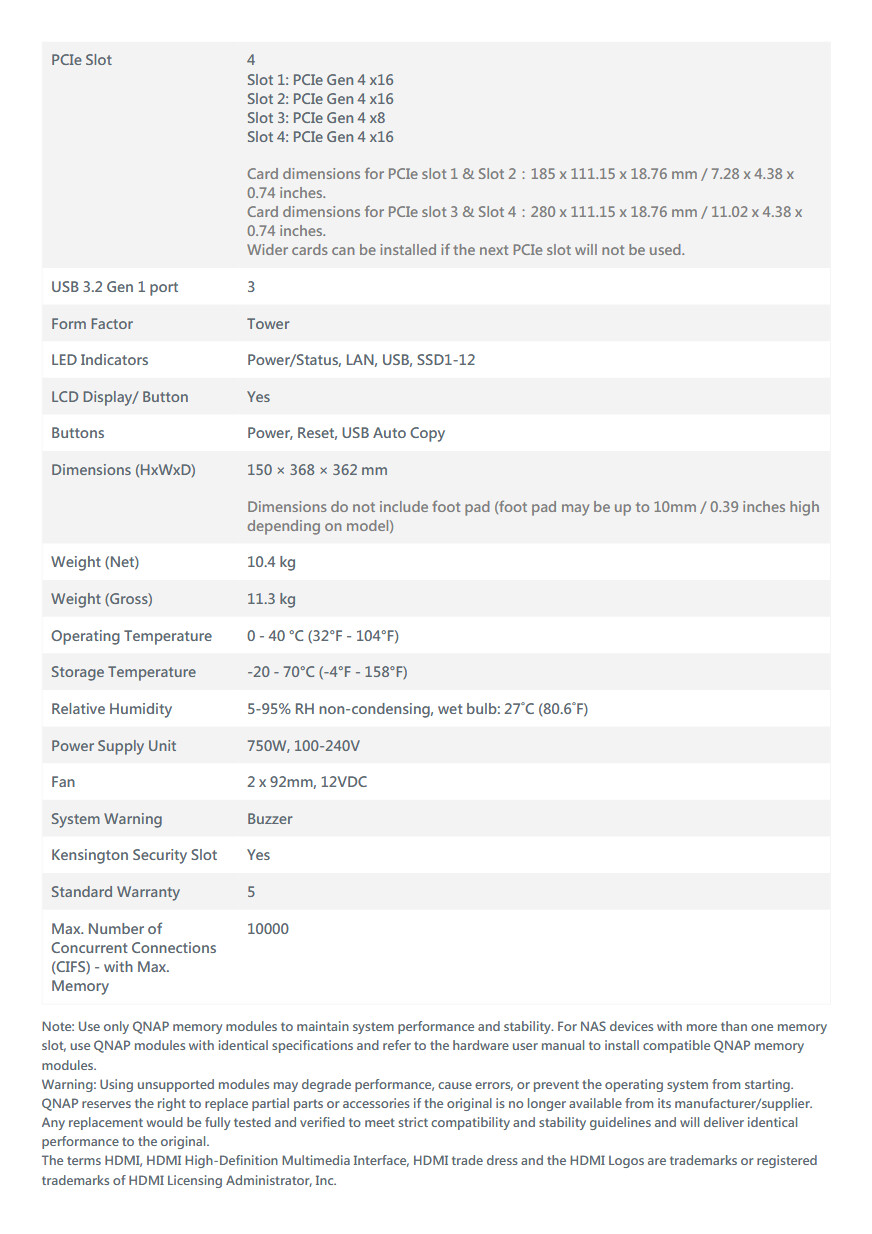

GPU 대응 아키텍처: 최대 96GB의 GPU 메모리를 갖추고 CUDA, TensorRT 및 Transformer Engine 가속을 지원하는 선택 사양인 NVIDIA RTX PRO 6000 Blackwell Max-Q 워크스테이션 GPU를 지원하여, 온프레미스 LLM 추론, 이미지 생성 및 딥러닝 워크로드의 성능을 대폭 향상시킵니다.

-

컨테이너화된 AI 환경 및 GPU 리소스 관리: 직관적인 GPU 할당 기능과 함께 Docker 및 LXD를 지원합니다. 사용자는 내장된 AI 앱 센터를 통해 AI 도구를 빠르게 실행하고 명령줄 구성 없이 GPU 리소스를 할당할 수 있습니다.

-

클라우드 의존성 없는 완전한 로컬 배포: AI 기반 채팅 어시스턴트, 문서 검색 엔진 또는 지식 베이스를 완전히 온프레미스에서 실행하십시오. 민감한 데이터를 내부적으로 유지하면서 AI 워크플로우를 가속화할 수 있습니다.

-

고속 네트워킹 및 확장 가능한 아키텍처: 듀얼 25GbE 및 듀얼 2.5GbE 포트가 기본 제공됩니다. PCIe 슬롯은 선택 사양인 100GbE 업그레이드를 지원합니다. 대규모 AI 데이터 스토리지를 위해 QNAP JBOD 확장 인클로저와 호환됩니다.

활용 사례 하이라이트

-

내부 AI 어시스턴트 / 온프레미스 채팅 인터페이스 지식 검색, 직원 교육 및 정책 Q&A를 위한 대화형 AI 인터페이스를 사용자의 완전한 통제 하에 배포할 수 있습니다.

-

기업용 RAG 검색 프라이빗 RAG 파이프라인을 활용하여 계약서, 보고서 및 내부 문서 전체에 대해 빠르고 문맥에 맞는 검색을 수행할 수 있습니다.

-

크리에이티브 팀을 위한 이미지 생성 AI 기반 디자인 워크플로우 및 시각적 콘텐츠 생성을 위해 Stable Diffusion 또는 ComfyUI를 실행할 수 있습니다.

-

AI 기반 IT 자동화 n8n을 사용하여 추론 작업, 콘텐츠 생성 또는 알림을 자동화함으로써 AI를 비즈니스 프로세스에 원활하게 통합할 수 있습니다.

QAI-h1290FX를 통해 QNAP은 기업 경계 내에서 생성형 AI를 배포할 수 있는 실용적이고 고성능의 경로를 제공합니다. 법률, 인사, 크리에이티브 또는 IT 운영 등 어떤 분야에서 사용되든, 이 솔루션은 팀이 더 빠르게 움직이고 규정을 준수하며 AI 전략에 대한 완전한 제어권을 바로 그 현장(엣지)에서 유지할 수 있도록 돕습니다.'

제품페이지 : https://www.qnap.com/en/product/qai-h1290fx

--------------------------------------------------------------------------------------광고(Advertising)--------------------------------------------------------------------------------------------------------