**번역본뉴스입니다. 오역이 있을수 있습니다.

슈퍼마이크로 주식회사는 AI, 클라우드, 스토리지, 5G/Edge를 포함한 총 IT 솔루션 공급 업체로서 AMD Instinct MI350 시리즈 GPU 및 플랫폼을 사용하여 액체 냉각과 공기 냉각 GPU 솔루션이 모두 제공될 것이라고 발표했습니다. 이 새로운 GPUs는 최상의 성능, 최대 확장성 및 효율성을 위해 최적화되었습니다. AMD Instinct MI350 시리즈 GPU를 포함하며 두 개의 AMD EPYC 9005 CPU를 갖춘 슈퍼마이크로 H14 세대의 GPU 최적화 솔루션은 조직이 AI 데이터 센터에서 총 소유 비용을 줄이면서 극대화된 성능을 확장할 수 있도록 설계되었습니다.

"슈퍼마이크로는 AI 및 HPC 응용 프로그램을 위해 고성능 시스템을 설계하는 산업에서 가장 많은 경험을 보유한 리더로 남아있습니다," 슈퍼마이크로의 회장 겸 최고경영자인 찰리스 라이앙(Charles Liang)은 말했습니다. "데이터 센터 건축 모듈 솔루션(Data Center Building Block Solutions)을 통해 우리는 데이터 센터의 최신 기술을 가장 요구가 높은 응용 프로그램에 도입하기 위해 시장에 빠르게 종단 간 솔루션을 배포할 수 있습니다. 새로운 AMD Instinct MI350 시리즺 GPU를 우리의 GPU 서버 라인업에 추가함으로써 우리의 AI 솔루션 리더십을 강화하고 확장하며, 고객들은 다음 세대 데이터 센터를 설계하고 구축할 때 더 많은 선택지와 향상된 성능을 얻게 됩니다."

슈퍼마이크로의 H14 세대 데이터 센터 솔루션은 AI, HPC, 클라우드 및 엔터프라이즈 워크로드를 위한 뛰어난 성능과 유연성을 제공합니다. 이 시스템들은 슈퍼마이크로의 검증된 건축 모듈 아키텍처에 기반하여 엔터프라이즈 고객이 워크로드를 효율적으로 업그레이드하고 확장할 수 있도록 설계되었습니다. 새로운 슈퍼마이크로 GPU 서버는 최신 AMD EPYC CPU와 함께 AMD Instinct GPUs를 특징으로 하여 AI 기능을 갖춘 솔루션 패밀리의 전력을 끌어올립니다. 이것은 슈퍼마이크로가 데이터 센터 건축 모듈 솔루션(DCBBS)으로 고객의 성공을 보장하면서 컨설턴트에서 온사이트 배치 및 지원까지 확실히 이끄는 데 도움을 줍니다.

"우리의 새로운 AMD Instinct MI350 시리즈는 경쟁 제품에 비해 최대 40% 더 많은 토큰-당-달러를 제공하면서 OEM 인프라 호환을 위한 산업 기준 형식 요소를 유지합니다," AMD의 회장 겸 CEO인 리사 수(Lisa Su) 박사는 말했습니다. "이 GPU들을 슈퍼마이크로의 검증된 플랫폼과 결합함으로써 그들의 고객은 AMD 기술 전체로 구축된 완전히 통합된 액체 또는 공기 냉각 랙을 배치할 수 있습니다. 이것은 다음 세대 AI 솔루션을 배포하기 위해 필요한 유연성과 효율성을 제공합니다."

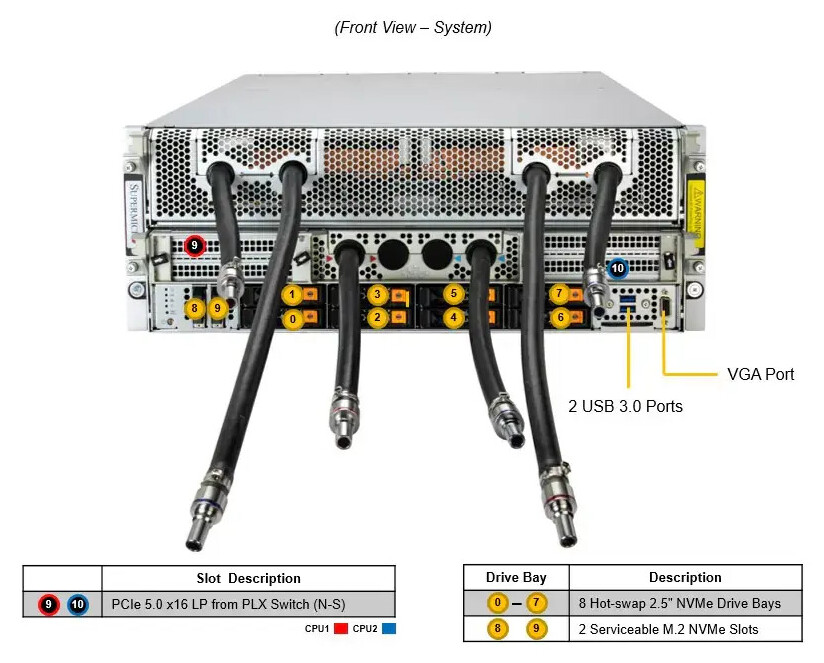

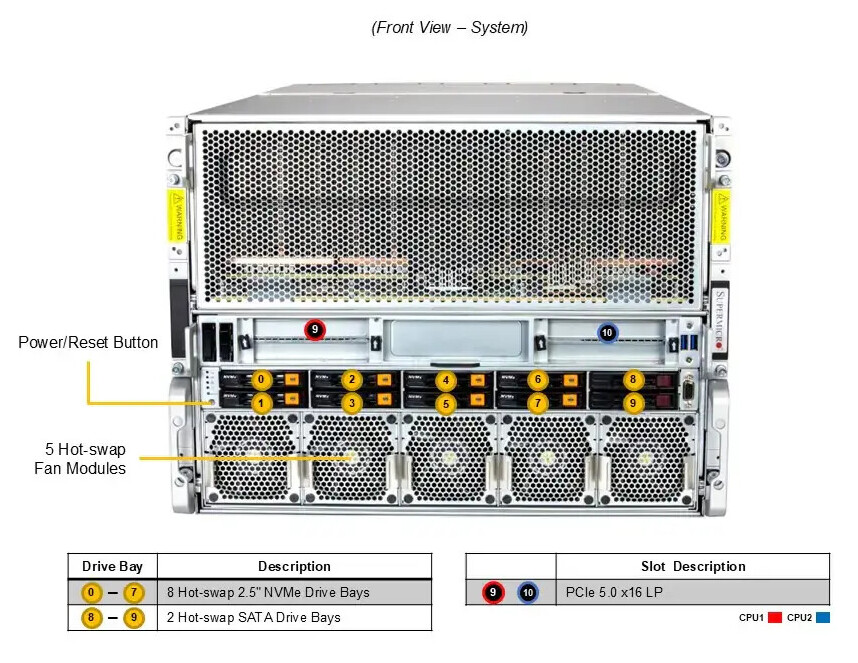

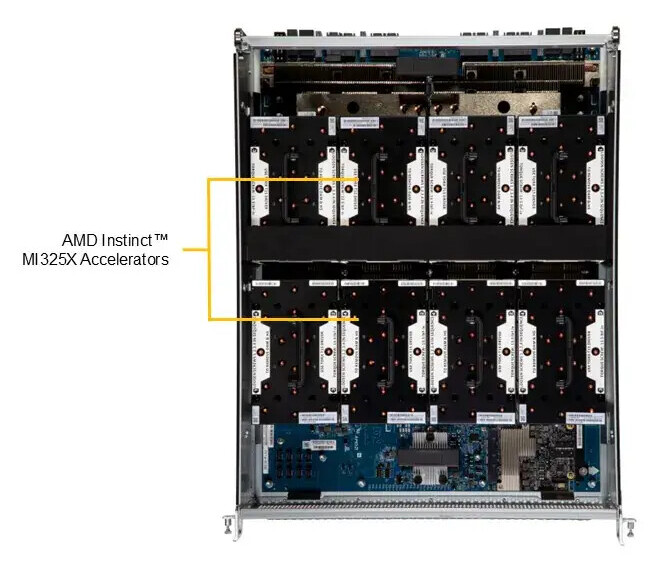

슈퍼마이크로는 AMD Instinct MI350 시리즈 GPU를 지원하는 최신 오픈 다중 아키텍처 산업 기준 OCP Accelerator Module(OAM)을 활용하여 검증된 액체 냉각 및 공기 냉각 고성능 8-GPU 시스템을 확장합니다. 보다 높은 밀도의 환경에서, AMD Instinct MI355X GPU를 특징으로 하는 새로운 슈퍼마이크로의 DLC(직접 액체 냉각) 아키텍처를 포함한 개선된 4U 액체 냉각 시스템은 서버 컴포넌트 다양한 측면을 식혀 전력 소비를 최대 40%까지 줄이는 새로운 기술을 통합하여, 랙당 더 높은 성능을 개방하고 확장된 냉각 인프라를 지원합니다. 고객은 더 높은 밀도의 랙 스케일 배치에 대해 4U 액체 냉각 옵션을 선택할 수 있으며, 공기 냉각 환경에서는 8U 옵션을 사용할 수 있습니다.

이 가속화된 GPU 서버들은 AI 추론을 위한 계산 처리량, 메모리 대역폭 활용 및 에너지 효율성을 극대화하여 더욱 효율적인 전력 소비를 가능하게 합니다. AMD Instinct MI350 시리즈로 이 가속화된 GPU 서버들은 각각 288GB HBM3e 메모리, 이전 세대의 AMD Instinct 악셀레이터에 비해 메모리 용량을 1.5배 증가시키고, 8TB/s 대역폭 및 FP16/FP8에서 1.8배 페타플롭스를 제공하여 고객이 AI 워크로드에 사용할 데이터를 더 빨리 처리할 수 있게 합니다.

"AI 모델은 크기뿐만 아니라 실제 환경에서 지속적으로 배포 가능한 인프라를 요구합니다," ABI Research의 산업 분석가인 폴 쉘(Paul Schell)은 말했습니다. "슈퍼마이크로는 AMD MI350 시리즺 GPU를 최신 H14 세대에 추가함으로써 AI 학습과 추론을 위해 최적화된 확장 가능한 고성능 및 메모리 솔루션을 제공하는 데 헌신하고 있음을 보여줍니다. 액체와 공기 냉각에 모두 지원되는 이 시스템들은 CSP, neo-clouds 및 엔터프라이즈가 AI 성장의 다음 파도를 켜기 위해 필요한 유연성과 효율성을 제공합니다."

4세대 AMD CDNA 아키텍처에 기반하며, 슈퍼마이크로는 클라우드 서비스 공급자 및 엔터프라이즈 파트너를 위해 AI를 규모화하는 새로운 GPU 솔루션을 설계하고 있습니다. AMD Instinct MI350 시리즈는 AI 학습, 추론 및 복잡한 과학적 시뮬레이션과 같은 다양한 워크로드에 대해 놀라운 성능과 에너지 효율성을 제공합니다. 새로운 AMD MI350 시리즈는 AI 배포를 위해 보다 큰 모델을 처리할 수 있는 FP6 및 FP4 데이터 유형도 포함하여 뛰어난 AI 기능을 제공할 것입니다.

--------------------------------------------------------------------------------------광고(Advertising)--------------------------------------------------------------------------------------------------------

macOS 타호(Tahoe)에서 새로운 디스크 이...

macOS 타호(Tahoe)에서 새로운 디스크 이...

AMD, EPYC "베니스(Venice)&quo...

AMD, EPYC "베니스(Venice)&quo...